【Google社員独占インタビュー】「Bard」についてGoogleのゲイリー氏に直球質問してきた(北米最大級のSEOカンファレンスにて)

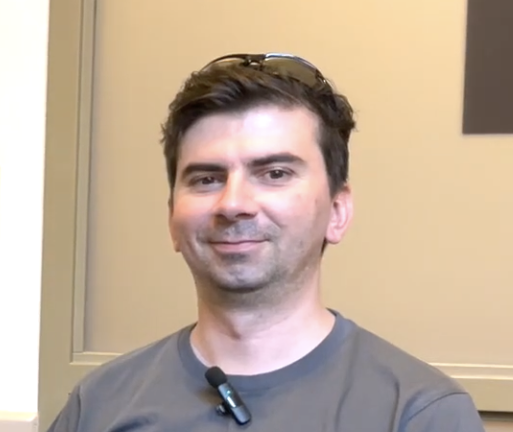

更新日: 2024.12.26 公開日:2024.11.26北米最大級のSEOカンファレンス「Pubcon Austin 2023」にて、GoogleのウェブマスタートレンドアナリストであるGary Illyes(ゲイリー・イリーズ)氏に、ミエルカチャンネル独占インタビューをしてきました。

内容はGoogleの生成AIであるBardをはじめ、「AIのあれこれ」です。

※この動画は、2023年3月に公開されたものです

▼動画でみたい方はこちら▼

海外SEO情報ブログ – SuzukiKenichi.COM: 海外SEO

▶︎https://www.suzukikenichi.com/blog/

Web担当者フォーラム執筆記事

▶︎https://webtan.impress.co.jp/user/1730/articles

X(旧Twitter)

▶https://x.com/suzukik

GoogleのAIチャット『Bard』について

鈴木:社内テストでBardというGoogleのAIチャット機能を試してみましたか?

Gary Illyes:はい。もちろんです。

鈴木:現時点[1]では、その全ての機能について明らかにすることはできないと思いますが、何か言えることはありますか?

Gary Illyes:あまり多くは言えませんが、ChatGPTなど、大規模言語モデルを使った多くのツールを参考にしています。大規模言語モデルに質問やリクエストを入力すると、何かが返ってきますよね。Bardも本質的にはそれとよく似ています。

しかし、Bardはまだ一般公開されていないことを覚えておく必要があります。完成した製品がどうなるかはわかりません。まだ一般公開できる状態ではないからです。

鈴木:社内での期待値は高いですか?

Gary Illyes:Googleでは、常に可能な限り最高の品質の製品をリリースしようと努めています。Bardも例外ではありません。まずは、適切なユーザーに向けてローンチしようと考えています。

[1]2023年3月時点

サーチコンソールとBardは統合されるのか?

鈴木:MicrosoftはBing Webmaster ToolsとBing AIチャットの統合を発表しました。Googleはどうでしょうか?サーチコンソールでBardをモニタリングできるようにする予定はありますか?

Gary Illyes:良い質問ですね。Bardはまだ公開されていないので、実際にはお答えできないと思います。最終的な目標は、クリエイターとユーザーの両方に最高の体験を提供することです。そういった意味では、サーチコンソールとの統合も、欠かせないものになってくるでしょう。

参考:Googleサーチコンソールとは?できること6つ・使い方の基本をわかりやすく解説!

GoogleはAIで作られたコンテンツを識別できる?

鈴木:次の質問です。GoogleはAIが生成したコンテンツを識別できますか?

Gary Illyes:品質の観点から、AIが生成したコンテンツを識別する必要があるかどうかという意味であれば、おそらくその必要はないでしょう。私たちが重視しているのは、コンテンツの実際の品質です。コンテンツがどのように生成されたか、どのように作成されたかは特に気にしません。ウェブサイトやソーシャルメディアなどに出されているコンテンツが実際に高品質であるかどうかを重視しています。

鈴木:つまり、AIによって作成されたか人間によって作成されたかは問題ではなく、高品質であるかどうかが重要ということですね?

Gary Illyes:そうです。

ほとんどの場合、大規模言語モデルによって作成されたコンテンツを、人間が直接レビューすることになると思います。なぜなら大規模言語モデルは、実際には品質の感覚を持っていないからです。したがって、人間の監督が必要になってきます。

鈴木:監督とは?

Gary Illyes:これらの大規模言語モデルによって作成されたコンテンツをレビューする役割のことです。例えば、大規模言語モデルを使って、自社サイトで何かを執筆した場合に、その内容を確認して、実際に正確かどうか、高品質であるかどうかを確認しなければなりません。

鈴木:つまり、品質が高ければ、コンテンツが人間によって書かれたかAIによって書かれたかは本当に重要ではないということですね。

Gary Illyes:その通りだと思います。最終的に私たちが気にしなければならないのは、コンテンツの質であり、誰が、何を作成したかではありません。

AIと人間が書いたコンテンツのどちらも同等に品質が高かった場合、検索結果には影響する?

鈴木:人間が書いたコンテンツとAIが書いたコンテンツが同等に関連性が高く高品質だった場合、検索結果に違いは出るでしょうか?

Gary Illyes:違いは出ないでしょう。最終的に私たちが重視しているのは、コンテンツがユーザーの求めている答えを提供することです。現在ではほとんどの場合、Webサイトへのリンクになると思います。高品質のコンテンツが人間によって作成されたか、AIによって作成されたかは実際には問題ではありません。私たちの目標は、ユーザーがあなたのサイトの情報を見つけられるようにすることです。

SEOのために生成AIを使うときの注意点

鈴木:SEOのためにChatGPTやBing AIチャットのようなAIチャットを使用する際に、やった方が良いこととやらない方が良いことは何ですか?

Gary Illyes:最もおすすめなのは、生成されたコンテンツを人間が確認することです。これは、全てのSEO担当者のワークフローに組み込まれるべきだと考えています。コンテンツが高品質であることを、誰かが確認する必要があるのです。ニュースであれば、ジャーナリストが書いたものをレビューする編集者がいますよね。LLMでコンテンツを作成する場合は、あなたが編集者です。大規模言語モデルが書いたものをレビューし、それを改善する必要があるか、そのまま公開できるかを判断しなければいけません。

もちろん、これには専門知識が必要です。正しい情報を提供しているか、有用な情報を提供しているか、などを確認しなければいけないからです。その時点で、そのコンテンツがあなたによって作成されたのか、ChatGPTなどの大規模言語モデルによって作成されたのかは問題ではありません。人間がレビューし、レビューの段階で専門知識を反映させたのであれば、記事を自分で執筆するという1つのステップをスキップしただけになります。

鈴木:レビューの際に専門性が必要であるということは、ある意味、あまり詳しくないトピックを作成する際にAIに頼ることはお勧めしませんか?

Gary Illyes:そう思います。例えば、「Bardはいつ公開されるのか」とLLMに聞いた場合、インターネット上のどこにもその情報がなくても、答えようとするでしょう。一方で、もしジャーナリストとして何かを書くとしたら、日付をでっち上げようとはしないですよね。公開日は未定で、いつ公開されるかわからない、と説明するでしょう。これは、LLMと大きく異なる部分です。

LLMが優れた情報源となるものもあります。例えば、恐竜やつけ麺など、すでに情報があることについて書くのはとても得意です。しかしLLMは、情報がないことについては書くことができないのです。

GoogleはAIを検索順位の決定以外にも利用している?

鈴木:これが最後の質問です。Googleは、検索順位の決定以外にAIを使用していますか?例えば、クロールの頻度を決定したり、インデックスするURLを決定したりするために、AIを使っていますか?

Gary Illyes:正確にはお答えできませんが、Google社内ではAIが広く使用されています。私が携わった、あるいは携わっているプロジェクトでは、すべて何かしらAIを使用しています。クロールスケジューリングやインデックス作成に使用されているかどうかは言えませんが、AI自体は非常に広く普及しています。

鈴木:あなたはJavaScriptが好きではない、邪悪だと思っているそうですが、AIについてはどうですか?

Gary Illyes:AIは、私たちが持っている他のツールと同じくらい邪悪だと思います。例えば、スマートフォンは邪悪でしょうか?邪悪なことに使うことはできますが、ツール自体は邪悪ではないでしょう。同じように、AIは本質的に邪悪なわけではありません。悪いことに使うこともできますが、素晴らしいものを作ることもできます。大量のデータを見てパターンを見つけるといった特定の作業では、人間よりもはるかに効率的です。これを利用しない手はありません。大量のデータからパターンを見つけ、見つかったパターンで何ができるか、どうすればいいかを見てみれば良いのです。

鈴木:AIを何のために、どのように使うかが重要ですね。

Gary Illyes:その通りです。

AIが経験していないことをあたかも経験したかのように書いた場合、Googleは検知できる?

市川:コンテンツが本当に役立ち、品質が高ければ、AIによって書かれたか人間によって書かれたかは問題ではないとのことですが、業界の基準や明確なチェックリストがあるわけではなく、これを満たせばコンテンツは高品質、というものが現状ありません。だからこそ、E-E-A-Tがここまで話題になっているのだと思いますし、私自身も、コンテンツがAIによって書かれたか人間によって書かれたかに関わらず、経験が重要だと考えています。

しかし、もしAIが経験をでっち上げたらどうでしょうか?もちろんAIは、自分の経験を語ることはできませんが、AIが「私はこの場所に行って、これを食べて、これを体験しました。ここに証拠があります」と言ったら、それが事実か作り話かを見分けることはできません。Googleはそれを検出できますか?それとも、何か対策はありますか?

Gary Illyes:素晴らしい質問ですね。これらの虚偽を検出する簡単な方法はないと思いますし、多くの場合、おそらく不可能でしょう。LLMがウェブから情報を取得すればするほど、そうした虚偽はより自然に見えてくると思います。現時点では、特に日本語や韓国語など、異なるトーンを持つ言語では、LLMによって書かれたものかどうかを人間が判断できるでしょう。しかし、最終的には、AIによって書かれたものかどうかを識別できないほど複雑なLLMが登場すると思います。人間とコミュニケーションしているときに人間だと思うような汎用AIを持つことが、AIを開発している人々の最終目標ですしね。

それが可能になった時、虚偽の判別は、実際にはそこまで問題にならないかもしれません。その時点で私たちが求めているのは、何かが事実上正しいかどうかを識別することです。その識別は非常に厄介な問題なので、現在、検索エンジンは一般的にそうした識別をさせたくないと思っています。むしろ私たちが考えているのは、ユーザーが答えや正しさを自分で識別する仕組みを提供できるかどうかです。

例えば、パリでの基調講演では、私たちの上司が「No Right Answer」について話しているのですが、それはまさに、インターネット上で合意がない、答えを一つに決められないことについて話しています。

「テキサス州オースティンからカリフォルニアまでどのように運転すればいいですか」と尋ねると、多くの道がありますよね。景観の良い道、砂漠の道、ルート66など、たくさんあります。つまり、正解はありません。同様に、さまざまな方法で答えることができるトピックは他にもたくさんあります。AIが何かをでっち上げた場合、それが正確かどうかは、最終的にはユーザーが判断することになると思います。

市川:今はそうした真偽の判断をユーザーが行っていますが、将来的には、Googleが虚偽を検出して、禁止する可能性もありますか?

Gary Illyes:将来どうなるかはわからないので、私たちGoogleがそれをやりたいかどうかということや、私たちが実際に今後何をするかは答えられません。しかし、私たちは常に、事実と異なるものを特定する方法を考えています。解決策があるかどうかはわかりません。

市川:わかりました。これで私の質問は終わりです。

鈴木:Garyさん、複雑な質問すべてに答えていただきありがとうございます。

Gary Illyes:お招きいただきありがとうございます。楽しい時間でした。さようなら。

参考:E-E-A-Tとは?E-A-Tに経験・体験(Experience)が追加、SEOへの影響は?

#Bard #生成AI #SEO #鈴木謙一 #GaryIllyes

この記事をシェア

この記事をシェア